In diesem Artikel

Unsere Motivation für diese Landschaft

Dieser Artikel soll allen, die sich für die ethische Debatte über Künstliche Intelligenz (KI) interessieren, einen schnellen Einstieg bieten und die weitere Recherche erleichtern. Er gibt einen breiten Überblick über den Status quo der anwendungsorientierten Debatte über den „verantwortungsvollen“ oder „ethischen“ Einsatz von KI zum Ende des Jahres 2018. Wir beleuchten die wichtigsten internationalen, ethischen KI-Praktiken, die dominierenden Akteure in den öffentlichen Debatten sowie deren Maßnahmen oder Prinzipien, die derzeit entwickelt und umgesetzt werden.

Wir beziehen keine Stellung dazu, was der „richtige“ oder „falsche“ Ansatz ist, sondern liefern Daten, damit Sie sich eine eigene Meinung bilden können. Bitte beachten Sie, dass dieses Thema Ende 2018 gerade erst Fahrt aufnimmt und wir es seitdem nicht mehr aktualisiert haben. Es enthält also beispielsweise noch nicht das Whitepaper der EU aus 2019.

Die Rolle der Ethik

Die Diskussion um die gesellschaftlichen Folgen von Künstlicher Intelligenz (KI) ist oft von zwei extremen Positionen geprägt: Eine überwiegend negative Sichtweise, welche die potenzielle vollständige Auslöschung der Menschheit voraussieht – und eine optimistische/enthusiastische, nach der wir kurz vor dem Eintritt in ein vollständig digitales, intelligentes Paradies stehen. Die Richtung, die unsere Gesellschaft einschlagen wird, basiert auf Debatten und Argumenten. Ethische Diskussionen sind notwendig, um gesamtgesellschaftliche Alternativen zu entwickeln, die für alle wünschenswert sind. Die Rolle der Ethik ist es, einen Leitfaden vorzugeben, was wir basierend auf dem gesellschaftlichen Konsens tun „sollten“. Die Technologie ermöglicht es uns, diese Alternativen zu gestalten.

Diverse Akteure haben bereits Richtlinien, Prinzipien und Rahmenwerke veröffentlicht, die den ethischen und verantwortungsvollen Umgang mit KI anleiten. Für einen umfassenden Überblick über die aktuellen Ansätze haben wir die ethischen Erklärungen und Richtlinien von vielen Gruppen und Akteuren gesammelt und ausgewertet. Unsere Übersicht berücksichtigt:

- Internationale Schwergewichte: die USA, China und die EU

- Länder und staatliche Akteure in Europa: Dänemark, Italien, Frankreich, Schweden, Finnland, Vereinigtes Königreich, Niederlande, Österreich und Deutschland

- Nichtstaatliche Akteure: Future of Life Institute, FAT / ML, Ethics in Artificial Intelligence, Open AI, Partnership on AI, AI4ALL, Ethics and Governance in Artificial Intelligence, AI Ethics Lab und das Stephen A. Schwarzman College of Computing

- Technologieunternehmen: Google, Amazon, Facebook, Apple und Microsoft

Stakeholder-agnostische Prinzipien: Ethically Aligned Design, Asilomar Principles, Toronto Declaration und Montreal Declaration werden ebenfalls kurz erläutert. - Andere Erklärungen: Ethically Aligned Design, Toronto Declaration und Montreal Declaration

Bevor wir diese Landschaft erstellt haben, gab es einige bemerkenswerte Veröffentlichungen. Sie haben uns motiviert, einen Überblick über den aktuellen Stand zu geben. Dies waren:

- (06/2014) China kündigt ein nationales Sozialkreditsystem für die Bewertung von Einzelpersonen und staatlichen Institutionen an.

- (06/2015) Die App „Google Fotos“ identifiziert afroamerikanische Menschen als Gorillas, weil die KI unzureichend trainiert wurde.

- (12/2015) Cambridge Analytica nutzt 50 Millionen Datensätze von Facebook-Nutzern, um durch gezielte Facebook-Posts deren politische Meinung in zahlreichen Wahlkämpfen zu beeinflussen.

- (05/2016) In Florida stirbt der erste Mensch in einem autonom fahrenden Auto. An einer Kreuzung konnte sein Tesla einen weißen Lkw nicht vom Himmel unterscheiden und beschleunigte kurz vor dem Aufprall.

- (03/2018) Die UN wirft Facebook vor, durch die Verbreitung von Hatespeech gewalttätige Unruhen in Myanmar zu fördern.

- (06/2018) Aktionäre von Amazon fordern Jeff Bezos in einem offenen Brief auf, seine Software „Recognition“ nicht für die Strafverfolgung zur Verfügung zu stellen.

Was ist KI-Ethik?

Die analysierten Quellen stützen sich auf diverse philosophische Ideen und Annahmen. Zudem werden einige ethische Prinzipien auf KI angewendet. Während wir uns nicht auf die philosophische Basis konzentrieren werden, sind die drei grundlegenden Ansätze zur Anwendung von Ethik in der KI wichtig. Sie kommen in den meisten Ansätzen vor:

- Ethics IN Design: Künstliche Intelligenz ist mehr als „nur eine“ Technologie. Wir verstehen das und helfen unseren Partnern, daraus Schlüsse zu ziehen. Wir schulen und bilden sie aus – von technischen Aspekten bis hin zu strategischen und gesellschaftspolitischen Elementen. Die Besten und Klügsten stehen immer auf den Schultern von Giganten. Helfen Sie uns, einigen der einflussreichsten Personen ‘da draußen’ das Thema KI zu vermitteln.

- Ethics BY Design: KI steckt noch in den Kinderschuhen, wenn wir uns den Einsatz in der breiten Masse und den technologischen Stack ansehen. Deshalb entwickeln wir mit unseren Partnern neue KI-Prototypen und -Tools in unzähligen Bereichen – von rein virtuell, wie Datenanalyse oder NLP, bis hin zu cyber-physisch, wie Drohnen und CV in der realen Welt. Wir stützen diese Entwicklungen auf modernste Technologien unserer Partner (NVIDIA, Google, Cisco, IBM, Pure etc.) und beschäftigen uns mit allem, was dazwischenliegt. Werden Sie Teil unseres Engineering-Teams.

- Ethics FOR Design: Künstliche Intelligenz ist dabei, das Geschäftsmodell großer Unternehmen zu verändern, und könnte ganze Branchen disruptieren. Es ist eine komplexe Aufgabe für Unternehmen und deren Führungskräfte, die Chancen, Risiken und Werte zu verstehen, die durch den Einsatz dieser Technologie möglich sind. Wir wissen das und helfen mit originellen Inhalten, diese Herausforderung zu meistern. Werden Sie Teil unseres Strategy-Teams.

Es liegt in der Natur der Ethik, zu beschreiben, was ein Unternehmen als „richtiges“ und „ethisches“ Verhalten ansieht. Daher beinhalten die meisten Ansätze, egal ob von staatlichen Akteuren oder Unternehmen, drei grundlegende Elemente: Ein gemeinsames, qualitatives Ziel, das erreicht werden soll; bestimmte Aktivitäten; und erwartete oder teilweise erreichte Ergebnisse. Während diese Struktur oft gleich ist, variiert die Umsetzung dieser drei Schritte stark. Die einen setzen auf kleine, top-down-definierte Gremien. Andere erwarten eine breite, aber langsame Diskussion und Konsensbildung. Die folgende Grafik zeigt die prominentesten Ansätze:

Ethik im Bereich KI: Bewertung & Recht

- Dieser Fragebogen der EU-Kommission hat den Zweck die Vertrauenswürdigkeit von KI-Systemen zu bewerten (Veröffentlichung 2019).

- Dieser Fragebogen der Initiative “DataEthics.eu” mit Sitz in Dänemark dient dazu einen sog. “Data Ethics Readiness Test” durchzuführen. Er hilft Unternehmen ihren Umgang mit Daten nach ethischen Gesichtspunkten zu bewerten (Veröffentlichung 2021).

- Zur ethischen Bewertung von KI-Systemen in der Öffentlichen Verwaltung hat die gemeinnützige Organisation AlgorithmWatch mit Sitz in Berlin zwei praktische Checklisten entwickelt.

- Der im April 2021 veröffentlichte Vorschlag der EU Kommission zur Regulierung von KI basiert auf der Arbeit der “AI High-Level Working Group” bestehend aus KI Experten aus ganz Europa und des Ergebnissen eines öffentlichen Konsolidierungsprozesses.

- Die “Normungsroadmap Künstliche Intelligenz” ist Teil der KI Strategie der Bundesregierung und wurde Ende 2020 von der DIN herausgegeben. Sie beschreibt ein Modell für die Risikobewertung von KI-Systemen (Seite 14) und enthält in Kapitel 6 (Seite 153) eine Übersicht existierender Normen im Bereich KI.

- In der Kurzfassung des Gutachten der Datenethikkommission (2019) sind grundlegende ethische Anforderungen zur Sammlung und Verarbeitung von persönlichen Daten zusammengefasst. Das Dokument geht auf gesetzliche Rahmenbedingungen und die Rolle von Daten für KI-Systeme ein.

- Die im Juli 2021 veröffentlichte Open-Data-Strategie der Bundesregierung enthält konkrete Handlungsempfehlungen an die Bundesverwaltung.

- Mit Blick auf die kommende Legislaturperiode veröffentlichte der KI-Bundesverband e.V. im Mai 2021 einen 8-Punkte-Plan für die Politik.

- Die Forscher*innen der ETH Zürich vergleichen 84 KI-Ethik Richtlinien aus unterschiedlichen Ländern und beschreiben inhaltliche Übereinstimmungen und Abweichungen (Stand 2019).

- Diese wissenschaftliche Publikation von Mitte 2021 (“Emerging Consensus on ‘Ethical AI’: Human Rights Critique of Stakeholder Guidelines”) untersucht 15 “starke” KI Ethik-Richtlinien aus unterschiedlichen Regionen mit Blick auf Übereinstimmungen und Lücken, auch im Zusammenhang mit bestehendem Recht.

- Eine Übersicht nationaler KI Strategien befindet sich in Kapitel 5 (Seite 83 pp.) in dem Report “The ethics of artificial intelligence: Issues and initiatives” des Europäischen Parlaments (Stand 2020).

- Dieses Video-Interview vom 25. Juni 2021 behandelt die unterschiedlichen Regulierungsansätzen in Europa und den USA.

Details zur Landschaft

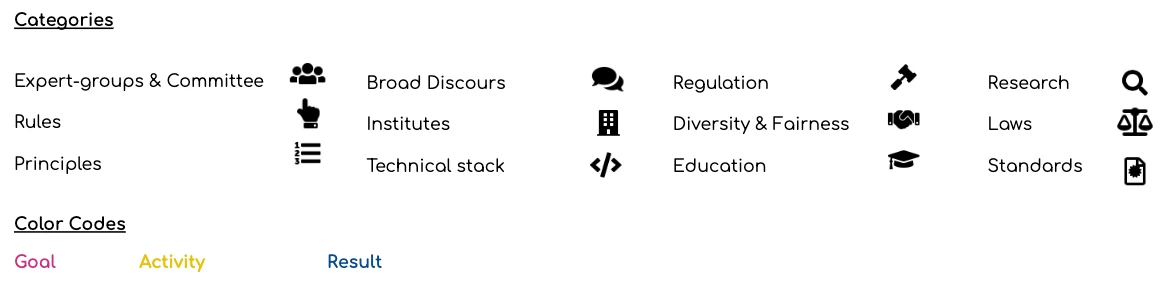

Die Landschaft basiert auf den folgenden Codes für Farben und Symbole.

Die Daten stammen aus mehreren Quellen:

Länder und staatliche Akteure in Europa

- Dänemark: Veröffentlicht: Januar 2018

Quelle: Strategy for Denmark’s Digital Growth

URL: https://eng.em.dk/media/10566/digital-growth-strategy-report_uk_web-2.pdf

Zusammenfassung: Dänemark beschreibt sich selbst als grundsätzlich gut darin, verantwortungsvoll zu arbeiten. Dementsprechend sind die Aussagen zum ethischen Vorgehen mit KI recht knapp. Der explizite Passus umfasst einige Zeilen und erwähnt allgemeine Maßnahmen wie die Etablierung einer Datenethik – möglicherweise einschließlich eines Datenethik-Kodex – und Diskussionen zum Thema in international relevanten Foren. Für 2020 sind Gesamtausgaben von 5 Mio. DKK (≈ 670.000 EUR) geplant. - Italien: Veröffentlicht: März 2018

Quelle: Artificial Intelligence. At the Service for Citizens

URL: https://ia.italia.it/en/

Ziel: Sicherstellen, dass KI immer zuerst den Bürgern dient

Zusammenfassung: Italien hat eines der umfassendsten Konzepte für KI-Ethik unter den EU-Staaten und will es gezielt einsetzen, um alle KI-Strategien daran auszurichten: Italien will mit einer bewussten Reflexion darüber beginnen, wie wir uns die Welt in Zukunft wünschen. Die Autoren beziehen sich auf die Tugendethik des Aristoteles. Gleichzeitig betonen sie, dass ein Austausch mit Anhängern anderer Ethiken (z. B. Kant, Konfuzianismus, Shintoismus oder Ubuntu) möglich ist, um das menschliche Wohlergehen zu verbessern. Sie bekräftigen das „anthropozentrische Prinzip“, wonach KI in erster Linie dem Bürger dienen sollte. Grundsätzlich scheint die ethische Anwendung von KI in der öffentlichen Verwaltung ein zentraler Bezugspunkt für die Überlegungen in Italien zu sein.

Ethik in der KI ist die Herausforderung Nr. 1 in Italiens KI-Strategie. Sie fordern, dass allgemeine Gerechtigkeitsprinzipien als Basis für Freiheit sowie individuelles und kollektives Recht formuliert werden, und schlagen vier „Elemente“ für die öffentliche Debatte und wissenschaftliche Analyse vor. Eine konkrete Maßnahme, die beschrieben wird, ist die Einrichtung eines transdisziplinären Zentrums für KI mit folgenden Zielen: Förderung einer Debatte über die Entwicklung der Ethik, Unterstützung der kritischen Reflexion über aufkommende ethische Bedenken und Erleichterung der Beteiligung von Experten und Bürgern bei der Ableitung von Vorschriften, Normen und technischen Lösungen auf der Grundlage technischer und sozialer Aspekte. - Frankreich: Veröffentlicht: März 2018

Quelle: AI for Humanity

URL: https://www.aiforhumanity.fr/en/

Zusammenfassung: Die KI-Strategie Frankreichs basiert auf dem Bericht des Mathematikers und Politikers Cédric Villani. Im Abschnitt „Ethical Considerations of AI Recent“ schlägt er beispielsweise eine spezielle Task Force aus zertifizierten Experten vor. Diese sollen damit beauftragt werden, Algorithmen auf verfassungsrechtliche Fragen hin zu prüfen und zu testen. Um KI-Experten auszubilden, empfiehlt er Ethics by Design als verpflichtenden Bestandteil. So soll von Anfang an ein Bewusstsein für ethische Fragen geschafft werden. Außerdem empfiehlt er eine Ethikkommission für digitale Technologie und KI, um eine transparente öffentliche Debatte zu führen. Trotz aller drängenden Fragen sollte aus dieser Debatte eine langfristige Perspektive erwachsen.

Präsident Macron folgt diesen und anderen Empfehlungen. Zu seiner offiziellen Strategie gehört die Idee einer internationalen Expertengruppe, ähnlich dem Intergovernmental Panel on Climate Change (IPCC). Die Gruppe soll unabhängige Erkenntnisse zu Transparenz und Fairness erarbeiten und in Bildungsprogramme einfließen lassen. Darüber hinaus muss KI verständlicher werden: ein besser erklärbares Modell, besser interpretierbare Schnittstellen und ein besseres Gesamtverständnis der zugrundeliegenden Mechanismen. Er möchte KI-Entwicklern Ethikschulungen und eine Folgenabschätzung zu Diskriminierung für ihre Algorithmen anbieten. Für den öffentlichen Sektor plant er, Algorithmen zur Vorhersage in der Strafverfolgung klar zu regulieren. Auch will er eine intensive internationale Debatte zu jeglichen Entwicklungen von LAWS (tödliche autonome Waffensysteme) bis hin zu einem Observatorium anstoßen, um deren Verbreitung einzudämmen. Als weitere Bedingungen ethischer KI nennt er Diversität und Inklusion. Konkret will er den Frauenanteil in den Studiengängen Digital Engineering bis 2020 auf 40 % erhöhen. Darüber hinaus möchte er die Ausbilder durch Richtlinien und Schulungen auf die Bedeutung von Vielfalt aufmerksam machen. Die Regierung sollte zudem den KI-Einsatz in sozialen Innovationsprogrammen fördern, damit auch Arbeitnehmer im sozialen Sektor davon profitieren können. - Schweden: Veröffentlicht: Mai 2018

Quelle: National approach to artificial intelligence

URL: https://www.regeringen.se/4aa638/contentassets/a6488ccebc6f418e9ada18bae40bb71f/national-approach-to-artificial-intelligence.pdf

Ziel: Helfen, nachhaltige KI zu schaffen

Zusammenfassung: Für Schweden ist „nachhaltige“ KI das übergreifende Motto. Das Land betont, dass Ethik, Schutz und Sicherheit keine nachgelagerte Überlegung, sondern ein integraler Bestandteil der frühen Entwicklungsphasen von KI sein müssen. Darüber hinaus strebt es den Aufbau von interdisziplinärem Wissen zu KI für Ingenieure und Entscheidungsträger an. Zudem werden transparente und verständliche Algorithmen für die Entwicklung von Regeln, Standards, Normen und ethischen Grundsätzen benötigt. Die ethischen Bemühungen müssen jedoch im Gleichgewicht mit den dringenden benötigten Daten stehen, um den gesellschaftlichen Nutzen von KI zu realisieren. - Finnland: Veröffentlicht: Mai 2018

Quelle: Work in the age of artificial intelligence Publications of the Ministry of Economic Affairs and Employment: Four perspectives on the economy, employment, skills and ethics

URL: http://julkaisut.valtioneuvosto.fi/bitstream/handle/10024/160980/TEMjul_21_2018_Work_in_the_age.pdf

Ziel: Technologie für wertvolle soziale Ziele nutzen

Zusammenfassung: Finnland hat sich dem „ehrgeizigen Ziel“ verschrieben, Technologie zu nutzen, um wertvolle soziale Ziele zu erreichen. Dabei liegt ein starker Fokus auf der Gestaltung von Arbeit. Eine gesellschaftliche Vision ist eine Voraussetzung dafür, dass die Regierung sinnvoll beeinflussen kann, wie KI entwickelt und angewendet wird. Die Autoren kritisieren, dass zum jetzigen Zeitpunkt keiner der zahlreichen internationalen Berichte eine Strategie oder einen Aktionsplan enthält, um die oft ersehnten, guten KI-Gesellschaften zu erreichen. Für eine solche Gesellschaft schlagen sie die Werte „Transparenz“, „Verantwortung“ und „umfassender gesellschaftlicher Nutzen“ vor. Sie betonen, dass die rechtliche und moralische Verantwortung von algorithmischen Anwendungen eindeutig beim Menschen verbleiben muss.

Wenn die zukünftigen Entwicklungen zum Verlust von Arbeitsplätzen führen, müssen die betroffenen Menschen unterstützt werden – schließlich haben sie den Fortschritt mit ihren Steuern bezahlt. Die Gesellschaft sollte gleichermaßen von den Vorteilen der KI profitieren. Zu diesem Zweck werden Mechanismen genannt, um diese Vorteile zu verteilen und Einkommenstransfers zu gestalten. Entwicklungen in der Arbeitswelt sollten auf zwei Ebenen diskutiert werden: der Gesamtgesellschaft und den einzelnen Arbeitsorganisationen.

Für einzelne Unternehmen würde der ethische Umgang mit KI zunehmend den Markenwert beeinflussen. Die großen Unternehmen haben das bereits verstanden. Es ist jedoch weitere Forschung aus technologischer, betriebswirtschaftlicher und politikwissenschaftlicher Sicht notwendig. Dies sollte zu einer internationalen Zusammenarbeit ausgebaut werden, wobei Finnland eine Vorreiterrolle einnehmen möchte, um KI-Strategien in der EU umzusetzen.

Eine erfolgreiche Strategie setzt eine umfassend aufgeklärte Bevölkerung zum Thema KI voraus. Finnland hat ein einzigartiges Programm vorgestellt, um das Verständnis von sowie die Vielfalt und Inklusion in der KI zu erhöhen: Mit seiner AI Challenge unterstützte Finnland seit Mai 2017 insgesamt rund 55.000 Bürger (1 % der Gesellschaft), selbst KI-Lösungen für ihre persönlichen Aufgaben zu entwickeln.

Weitere geplante Maßnahmen sind: eine parlamentarische Kontrollgruppe einzurichten, um den technologischen Fortschritt zu überwachen; eine am Gemeinwohl orientierte Wertebasis zu formulieren (mit einem Kompetenzzentrum speziell für den B2B-Bereich); und Online-Plattformen nach dem Vorbild der Europäischen Datenschutzgrundverordnung (DSGVO) zu regulieren. Insgesamt sollte, trotz der kaum absehbaren Entwicklungen im Bereich der KI, weiter experimentiert und Erfahrungen gesammelt werden. Dabei sollte man sich in kritischen Situationen auf die Unterstützung durch staatliche Institutionen verlassen können. - Vereinigtes Königreich: Veröffentlicht: Juni 2018

Quelle: Data Ethics Framework

URL: https://assets.publishing.service.gov.uk/government/uploads/system/uploads/attachment_data/file/737137/Data_Ethics_Framework.pdf

Ziel: Weltmarktführer für ethische KI werden

Zusammenfassung: Das Vereinigte Königreich formuliert unmissverständlich seinen Anspruch, „Weltmarktführer für ethische KI“ zu sein. Der Fokus liegt auf dem ethischen Umgang mit vertraulichen Daten, um deren Verfügbarkeit und Austausch zu erleichtern. Zentrale Instrumente, um ethische KI sicherzustellen, sind Data Trusts und ein Centre for Data Ethics and Innovation (CDEI). Letzteres scheint bereits die offizielle Informationsstelle für den konkreten ethischen Ansatz des Vereinigten Königreichs zu sein. Es soll als langfristige Schnittstelle zwischen Regierung, Wirtschaft und Zivilgesellschaft fungieren. Konkret soll die Regierung bei der Gesetzgebung unterstützt werden. Weiterhin will man mit Forschungseinrichtungen und Think Tanks zusammenarbeiten, um nationale Herausforderungen und globale Chancen zu identifizieren. Führenden Unternehmen soll ebenfalls eine Wissensbasis und Plattform angeboten werden, auf der sie Best Practices austauschen können.

Die Grundgedanken des CDEI zu ethischer KI decken sich weitgehend mit dem allgemeinen Diskurs: die Vielfalt unter den Entwicklern erhöhen sowie Fairness, Transparenz, Haftung und Verantwortlichkeit sicherstellen. Die folgenden Handlungsfelder erhalten vergleichsweise mehr Aufmerksamkeit: Targeting von Bürgern durch Werbetreibende, Rahmenbedingungen für den Austausch von Daten, intellektuelles Kapital und Eigentumsrechte für durch KI generierte Innovationen. - Niederlande: Veröffentlicht: Oktober 2018

Quelle: AI voor Nederland. Vergroten Versnelen en Verbinden

URL: https://order.perssupport.nl/file/pressrelease/a253ded8-1863-4d07-b79d-72639baefc51/6be5dcdc-b9d8-4675-bd80-9425826c840c/AIvNL20181102final.pdf

Zusammenfassung: Die öffentlich-private Partnerschaft AINED hat zusammen mit der Boston Consulting Group (BCG) einen ersten Bericht für die Niederlande veröffentlicht. Der Bericht enthält lediglich den Hinweis, kontinuierlich Erfahrungen mit KI und ihren gesellschaftlichen Folgen zu sammeln und dann Regelungen für die Technologie zu formulieren. Beobachter sehen einen dringenden Handlungsbedarf, damit sich die Niederlande nicht weiter von ihrer ehemals guten Wettbewerbsposition entfernen. AINED und BCG haben eine nationale Strategie für die kommenden Monate angekündigt. - Österreich: Veröffentlicht: November 2018

Quelle: Die Zukunft Österreichs mit Robotik und Künstlicher Intelligenz positiv gestalten. Whitepaper des Österreichischen Rats für Robotik und Künstliche Intelligenz

URL: https://www.acrai.at/images/download/ACRAI_whitebook_online_2018.pdf

Ziel: Rechtlicher und moralischer Rahmen für die Verlagerung von Entscheidungskompetenzen auf KI-Systeme

Zusammenfassung: Österreich ist das einzige untersuchte Land, das Robotik in seinem ethischen Ansatz zu KI gleichberechtigt anspricht. Interessant ist die Feststellung, dass der moralische Status von Robotern und KI „derzeit unklar“ ist. Die meisten anderen Autoren von ethischen Verfahren würden dem wohl aktuell widersprechen und jeden moralischen Status ausschließen. Österreich ist auch der einzige EU-Staat, der LAWS (tödliche autonome Waffensysteme) kategorisch verbietet. Abgesehen davon scheinen die anderen Aussagen mit dem allgemeinen Diskurs übereinzustimmen.

Österreich bezieht sich in seinem ethischen Ansatz von Beginn an auf die Werte der Europäischen Menschenrechtskonvention. Dazu gehören z. B. Gerechtigkeit, Fairness, Vielfalt und Inklusion. Dies setzt voraus, dass die Technologie transparent und sicher ist. Derzeit müssen Menschen jede ethische Entscheidung in Bezug auf KI treffen und verantworten. Eine Verlagerung der Entscheidungskompetenz auf das KI-System erfordert einen klaren rechtlichen und moralischen Rahmen. Darüber hinaus sollten „rechnerische Vorkehrungen für ethisches Verhalten“ direkt in die Architektur und das Design der Maschinen (Ethics by Design) integriert werden. Um alle weiteren Entscheidungen am Gemeinwohl der Bevölkerung auszurichten, plant Österreich zudem umfangreiche Expertenbefragungen und öffentliche Diskussionen. - Deutschland: Veröffentlicht: November 2018

Quelle: Strategie Künstliche Intelligenz der Bundesregierung

URL: https://www.bmbf.de/files/Nationale_KI-Strategie.pdf

Ziel: Mit Ethikrichtlinien zur Marke „AI made in Europe“ beitragen

Zusammenfassung: Die deutsche KI-Strategie enthält die konkretesten Maßnahmen und Budgetdaten der verglichenen Staaten. Der beschriebene ethische Ansatz hingegen entspricht in seinem Abstraktionsgrad in etwa dem europäischen Durchschnitt.

Grundsätzlich ist der regulatorische Rahmen durch die deutsche Gesetzgebung und die DSGVO bereits sehr stabil. Jedoch müssen Lücken bei Algorithmus- und KI-basierten Entscheidungen, Diensten und Produkten untersucht werden. Wie bei vielen anderen ethischen Verfahren sind Transparenz, Nachvollziehbarkeit und Überprüfbarkeit der Algorithmen erforderlich, um Verzerrung und Manipulation zu vermeiden. Es wird geprüft, ob dafür auch staatliche Stellen eingerichtet oder ausgebaut werden sollten. In jedem Fall sind Prüfungsstandards und Standards für die Folgenabschätzung geplant. Auch sollen die technologischen Möglichkeiten ausgelotet werden, um Recht und ethische Grundsätze durchzusetzen.

Ein Schwerpunkt wird auf der digitalen Bildung der Bürger liegen. Der Einzelne soll in Bezug auf KI befähigt werden und selbstbestimmt handeln. Ethische Fragen und soziologische Zusammenhänge sollen Teil von Lehre, Aus- und Weiterbildung werden. Informationskampagnen sollen die Digital- und Medienkompetenz der Bürgerinnen und Bürger fördern sowie eine kritische Reflexion anhand von realistischen Anwendungsszenarien ermöglichen und motivieren. Die Regierung betont, wie wichtig es ist, die Gesellschaft aufzuklären und kontinuierlich ethische Rahmenbedingungen unter gleichberechtigter Einbeziehung der technischen, natur-, geistes- und sozialwissenschaftlichen Disziplinen zu diskutieren. Hierfür sollen Foren und Debatten angeregt werden. Die Bundesregierung selbst beschreibt ihren Ansatz als „Ethics by, in and for Design“ und möchte damit einen Beitrag zur Marke „AI made in Europe“ leisten.

Internationale Schwergewichte

- China: Veröffentlicht: Juli 2017

Quelle: Next Generation Artificial Intelligence Development Plan

URL: https://chinacopyrightandmedia.wordpress.com/2017/07/20/a-next-generation-artificial-intelligence-development-plan/

Zusammenfassung: China wird aufgrund des für 2020 angekündigten Sozialkreditsystems oft als negatives ethisches Beispiel dargestellt. Aber auch dort verschärft sich die ethische Debatte rund um das Thema der moralischen Agenten. Der 2017 vorgelegte KI-Entwicklungsplan ist zumindest in Bezug auf die Menge und Konkretheit der Angaben zu ethischen Verfahren durchaus mit europäischen Strategien vergleichbar. Wie bei allen anderen Strategien werden auch hier ethische Normen, Gesetze und Vorschriften angestrebt. Ihre kontinuierliche Optimierung durch weitere Forschung ist bis 2030 geplant. Darüber hinaus sollen ein ethischer Rahmen für Mensch-Computer-Kollaborationen und ein ethischer Verhaltenskodex für Forschung und Entwicklung von KI-Produkten entwickelt werden. Potenzielle Risiken von KI sollen abschätzbar werden und es soll Lösungen für Notfallszenarien geben. In Industrie und Wirtschaft setzt China darauf, Selbstdisziplin zu fördern und die Arbeitsmoral der Manager zu stärken. Letzteres wurde in keinem anderen untersuchten Ethikansatz so formuliert. - USA: Veröffentlicht: Dezember 2017

Quelle: FUTURE of Artificial Intelligence Act

URL: https://www.congress.gov/bill/115th-congress/house-bill/4625/text

Ziel: Internationaler Marktführer für militärische Ethik und KI-Sicherheit werden

Zusammenfassung: In den USA liegt die staatliche Verantwortung für KI derzeit vor allem beim Pentagon. Im Januar 2019 begannen die USA, ethische Grundsätze für militärisch eingesetzte KI zu entwickeln. Der FUTURE of Artificial Intelligence Act ist das zentrale Dokument der bisherigen KI-Strategie des Landes. Das Gesetz empfiehlt Ethikschulungen für KI-Entwickler, rät aber auch zu prüfen, ob (!) und wie ethische Standards in die Entwicklung und Anwendung von KI integriert werden können. Im Februar 2019 veröffentlichte das Pentagon die Zusammenfassung der Department of Defense Artificial Intelligence Strategy von 2018: KI nutzen, um unsere Sicherheit und unseren Wohlstand zu fördern. Ziel ist es, international führend im Bereich der militärischen Ethik und KI-Sicherheit zu werden. Als Maßnahmen werden angegeben, Experten zu befragen, in Forschung und Entwicklung zu investieren und die Ergebnisse bereitzustellen, um internationale Standards für eingesetzte KI im militärischen Bereich zu schaffen. Dem in der öffentlichen Wahrnehmung noch gering erscheinenden Einsatz der US-Regierung im Bereich KI-Ethik steht eine Vielzahl von Nichtregierungsinstitutionen mit internationaler Reichweite gegenüber. - EU: Veröffentlicht: April 2019

Quelle: Ethics Guidelines for Trustworthy AI

URL: https://ec.europa.eu/futurium/en/ai-alliance-consultation

Ziel: Entwicklung eines ganzheitlichen Rahmenwerks für vertrauenswürdige KI-Systeme

Zusammenfassung: Die von der High Level Expert Group (HLEG) erarbeiteten Leitlinien der Europäischen Kommission zur KI-Ethik wurden im April 2019 veröffentlicht. Dem Bericht zufolge sollte eine „vertrauenswürdige“ KI über ihren gesamten Lebenszyklus hinweg drei Komponenten enthalten: Sie sollte gesetzeskonform, ethisch und robust sein. Der Bericht betont besonders die notwendige Ausrichtung der KI auf den Menschen und seine Bedürfnisse („human-zentriertes Design“). Nur wenn KI als „vertrauenswürdig“, d. h., als gutartig und technisch robust wahrgenommen wird, würden sich die Menschen darauf einlassen. Die EU unterstreicht damit, dass Ethik in der KI für deren Verbreitung und weitere Entwicklung notwendig ist.

Der Abschnitt über ethische KI schlägt ethische Leitlinien vor, die im Entwicklungsprozess und beim Einsatz von Systemen mit Künstlicher Intelligenz zu berücksichtigen sind. Sie sollten nach diesen Grundsätzen entwickelt werden: Achtung der menschlichen Autonomie, Vermeidung von Schäden, Fairness und Erklärbarkeit. Darüber hinaus sollte bei Entwicklung und Einsatz von KI-Systemen auf Vielfalt geachtet werden. So will man verhindern, dass ungeschützte oder historisch benachteiligte Gruppen sowie Situationen mit Macht- oder Informationsasymmetrien voreingenommen in das System aufgenommen werden. Zudem sollten Risiken, die potenziell durch KI-Systeme entstehen könnten und nicht mehr dem Einzelnen oder der Gesellschaft zugutekommen, vorausschauend betrachtet und gemindert werden. Diese ethischen Grundsätze werden in konkrete Anforderungen übersetzt, für die technische und nicht-technische Umsetzungsmethoden vorgestellt werden.

Darüber hinaus sieht die EU weitere konkrete Punkte vor, um vertrauenswürdige KI-Systeme zu entwickeln. Dazu gehören, Forschung, Innovation, Aus- und Weiterbildung zu fördern, Expertengruppen einzurichten sowie transparent über Fähigkeiten und Grenzen ethischer KI-Systeme zu kommunizieren.

Mit ihrem Bericht bietet die HLEG unter den untersuchten ethischen Verfahren den vollständigsten Rahmen für die Implementierung von ethischer KI. Sie zeigt einen Prozess zur Top-down-Umsetzung auf (von der ethischen Absicht zur konkreten Umsetzung in der Situation), der allerdings bottom-up entstanden ist (von der konkreten menschlichen Situation zur ethischen Absicht). Die EU-Kommission beabsichtigt, diesen dialektischen und dialogischen Prozess kontinuierlich fortzusetzen. Die HLEG schlägt ihrerseits vor, den Ansatz in Kursen und anderen Bildungsangeboten für KI-Entwickler und -Anwender zu vermitteln. Darüber hinaus plant die Europäische Kommission, eine führende Rolle in der weltweiten Debatte über ethische Grundsätze zu spielen und einschlägige Forschung zu unterstützen.

Institutionen

- Future of Life Institute: Veröffentlicht: Januar 2017

Quelle: Asilomar Principles

URL: https://futureoflife.org/background/existential-risk/

Ziel: Ziel der KI-Forschung sollte es sein, nicht ungerichtete Intelligenz, sondern nützliche Intelligenz zu schaffen

Zusammenfassung: Das 2014 in Cambridge gegründete Future of Life Institute ist eine außeruniversitäre Forschungseinrichtung, die sich mit den existenziell bedrohlichen Risiken von Atomkriegen, Biotechnologie, Klimawandel und Künstlicher Intelligenz beschäftigt. Mit der finanziellen Unterstützung von Elon Musk hat das Institut seit 2015 insgesamt 47 nutzbringende KI-Projekte mit Zuschüssen zwischen 100.000 und 1,5 Mio. USD gefördert (Future of Life Grants). Im Rahmen der 2017 Asilomar Conference entwickelte das Institut seine KI-Leitsätze – besser bekannt als Asilomar-Prinzipien.

Die 23 Asilomar-Prinzipien sind die bekannteste Liste von ethischen Prinzipien für nutzbringende KI. Sie wurden im Januar 2017 auf der Asilomar Konferenz in Kalifornien von rund 100 Experten aus KI, Wirtschaft, Industrie, Philosophie und Sozialwissenschaften formuliert. Zu den fast 4.000 Unterzeichnern der Prinzipien gehören unter anderem Elon Musk, Ray Kurzweil und Stephen Hawking. Die Prinzipien heben die Bedeutung von sicheren KI-Systemen, Transparenz der Algorithmen, Schutz der Privatsphäre und dem allgemeinen Nutzen von KI für die gesamte Menschheit hervor. - FAT / ML: Veröffentlicht: Juli 2016

Quelle: Principles for Accountable Algorithms and a Social Impact Statement for Algorithms

URL: http://www.fatml.org/resources/principles-for-accountable-algorithms

Ziel: KI-Entwicklern und Produktmanagern eine konkrete ethische Orientierung geben

Zusammenfassung: FAT / ML steht übersetzt für Fairness, Verantwortlichkeit und Transparenz beim maschinellen Lernen. Die seit 2014 jährlich stattfindende Konferenz richtet sich an internationale KI-Forscher, die sich mit informatischen Methoden beschäftigen, um ethische KI (Ethics by Design) sicherzustellen. Die „Principles for Accountable Algorithms and a Social Impact Statement for Algorithms“ wurden im Juli 2016 formuliert und sollen KI-Entwicklern und Produktmanagern eine konkrete ethische Orientierung geben. - Ethics in AI Initiative: Veröffentlicht: 2015

Quelle: Ethics in Artificial Intelligence Initiative

URL: https://www.cs.ox.ac.uk/efai/

Ziel: Wie können ethische Codes für KI entwickelt werden?

Zusammenfassung: Die Ethics in Artificial Intelligence Initiative wurde 2015 mit Mitteln aus den Future of Life Grants für die Oxford University gegründet. Die Initiative konzentriert sich weniger auf die ethischen Herausforderungen, die mit KI verbunden sind. Vielmehr geht es darum, wie ethische Codes entwickelt werden können und sollten. Eine umfassende Übersicht über ethische Codes sowie Links und Dokumente, um diese zu erstellen, werden online angeboten. - Partnership on AI: Veröffentlicht: September 2016

URL: https://www.partnershiponai.org/

Zusammenfassung: Partnership on AI ist eine der größten KI-Initiativen mit über 80 Partnern aus verschiedenen Branchen. Sie wurde im September 2016 u. a. von Facebook, Amazon und Google gegründet. Ihr Ziel ist es, gemeinsam mit den Partnern Best Practices für KI zu etablieren und die Bevölkerung über die Möglichkeiten und Reichweite der Technologie zu informieren. Die Partner haben sich zu acht ethischen Prinzipien verpflichtet. - AI4ALL: Veröffentlicht: 2017

URL: http://ai-4-all.org/

Zusammenfassung: AI4ALL ist eine gemeinnützige Bildungsinitiative, die Anfang 2017 an der Stanford University gegründet wurde. Ihr Ziel ist es, durch Ausbildung und etablierte Vorbilder die Vielfalt und Inklusion in der KI-Lehre, -Forschung, -Entwicklung und -Gesetzgebung zu erhöhen. Die Bildungsangebote richten sich speziell an Bevölkerungsgruppen, die an Universitäten unterrepräsentiert sind. - Ethics and Governance of Artificial Intelligence: Veröffentlicht: 2017

URL: https://aiethicsinitiative.org/

Zusammenfassung: Die in Harvard ansässige Ethics and Governance of Artificial Intelligence Initiative ist seit 2017 aktiv. Sie wurde in Zusammenarbeit vom Berkman Klein Center und dem MIT Media Lab mit einem Zuschuss der Knight Foundation in Höhe von 27 Mio. USD gegründet. Sie erforscht Möglichkeiten für private und öffentliche Entscheidungsträger, KI im öffentlichen Interesse einzusetzen. In einem offenen Wettbewerb gewährt die Initiative insgesamt 750.000 USD für Projekte zu vier ethischen Herausforderungen. - AI Ethics Lab: Veröffentlicht: Januar 2018

URL: http://aiethicslab.com

Zusammenfassung: Das AI Ethics Lab wurde im Januar 2018 ebenfalls an der Harvard University gegründet. Dort werden Forscher und Praktiker beraten und ausgebildet sowie Workshops und Vorträge zum ethischen Einsatz von KI gehalten. Der Mapping-Workshop hilft KI-Entwicklern, ethische Konfliktquellen in ihren Projekten zu identifizieren und Lösungen zu entwickeln, ohne die technische Integrität zu gefährden. - MIT Stephen A. Schwarzman College of Computing: Veröffentlicht: Oktober 2018

URL: http://news.mit.edu/2018/mit-reshapes-itself-stephen-schwarzman-college-of-computing-1015

Zusammenfassung: Im Oktober 2018 kündigte das Massachusetts Institute of Technology (MIT) eine Investition von 1 Mrd. USD an, um globale Chancen und Herausforderungen durch KI zu adressieren. Im Mittelpunkt steht die Gründung des Stephen A. Schwarzman College of Computing, benannt nach dem CEO des Vermögensverwalters Blackstone, der persönlich 350 Mio. USD gespendet hat. Die Förderung der Ethik in der KI wird ein wichtiger Bestandteil der Aktivitäten des Colleges sein. So sollen beispielsweise neue Lehrpläne entwickelt werden, die KI mit anderen Disziplinen verbinden. Ebenso sollen Foren organisiert werden, in denen führende Persönlichkeiten aus Politik, Wirtschaft, Forschung und Journalismus die möglichen Folgen der neuesten KI-Fortschritte diskutieren und Handlungsbedarf ableiten. Die Arbeiten werden voraussichtlich im September 2019 beginnen.

Technologieunternehmen

- Facebook: Veröffentlicht: Mai 2018

URL: https://www.forbes.com/sites/samshead/2018/05/03/facebook-reportedly-has-a-dedicated-ai-ethics-team/#5690de1d2e5c

Zusammenfassung: Facebook gab auf seiner Entwicklerkonferenz F8 im Mai 2018 bekannt, dass es ein eigenes Ethik-Team gebildet hat. Dieses Team arbeitet mit Entwicklungsteams im gesamten Unternehmen zusammen und hat die Software „Fairness Flow“ entwickelt, welche Verzerrungen in anderen KIs erkennt. Fairness Flow wurde in den FBLearner Flow integriert. Mit dieser Software trainiert Facebook seine Algorithmen. Wissenschaftliche Veröffentlichungen werden folgen. Facebook plant, die Voreingenommenheit seiner Software weiter zu minimieren, indem es die Vielfalt seiner Belegschaft erhöht. Zum Beispiel sollen Büros fernab des Silicon Valley eröffnet werden. Im Januar 2019 kündigte Facebook an, einen Ethik-Lehrstuhl an der Technischen Universität München für zunächst 6,6 Mio. EUR über fünf Jahre zu finanzieren, um u. a. ethische Richtlinien für KI zu entwickeln. - Google: Veröffentlicht: 2018

Quelle: Responsible AI Practices

URL: https://ai.google/education/responsible-ai-practices

Zusammenfassung: Google hat bereits im Jahr 2014 seinen KI-Ethikrat eingerichtet. Sowohl Mitglieder als auch Aufgaben sind unbekannt. Im Juni 2018 veröffentlichte Google seine Prinzipien für ethische KI und gab kurz darauf Empfehlungen für verantwortungsvolle KI-Praktiken ab. Im Dezember 2018 kündigte Google über seinen Blog ein umfassendes Maßnahmenpaket an. Dazu gehören Schulungen, eine Vortragsreihe zu KI-Ethik, ein Fairness-Modul im Crash-Kurs „Maschinelles Lernen“, ein interdisziplinäres Team für verantwortungsvolle Innovation, eine Gruppe erfahrener Senior-Berater und ein Beirat aus erfahrenen Führungskräften für komplexere Themen, die mehrere Produkte und Technologien betreffen. - Microsoft: Veröffentlicht: 2017

URL: https://www.microsoft.com/en-us/research/group/fate/

Zusammenfassung: Microsoft hat 2017 die Gruppe Fairness Accountability Transparency and Ethics (FATE) gegründet. Die Gruppe hat das Ziel, informatische Methoden zu entwickeln, die sowohl ethisch als auch innovativ sind. Publikationen dazu sollen folgen. Im selben Jahr kam AI and Ethics in Engineering and Research (AETHER) hinzu, ein unternehmensweit rekrutierter Beirat aus erfahrenen Führungskräften, um ethische Fragen frühzeitig zu erkennen und anzugehen. Microsoft veröffentlichte im Januar 2018 eigene ethische Grundsätze und formulierte im folgenden November ethische Richtlinien für die Entwicklung von KI-Chatbots. Im Dezember 2018 ergänzte das Unternehmen ethische Grundsätze für den Einsatz von Gesichtserkennung.

Andere

- Ethically Aligned Design: Veröffentlicht: 2016

Quelle: Ethically Aligned Design: A Vision for Prioritizing Human Well-being with Autonomous and Intelligent Systems

URL: https://standards.ieee.org/industry-connections/ec/ead-v1.html

Zusammenfassung: Die Broschüre „Ethically Aligned Design: A Vision for Prioritizing Human Well-being with Autonomous and Intelligent Systems“ basiert auf dem Input von mehreren hundert Experten von sechs Kontinenten. Die erste Version wurde im Jahr 2016 veröffentlicht. Eine zweite Version folgte im Jahr 2017 mit der Bitte um Feedback aus der Öffentlichkeit. Die überarbeitete Version soll im Jahr 2019 fertiggestellt werden. Sie konzentriert sich auf fünf Prinzipien, die einen ethischen Rahmen für das Design, die Entwicklung und die Anwendung von KI bilden. Die Broschüre wird von der Ethics in Action Initiative des American Institute of Electrical and Electronics Engineers (IEEE) herausgegeben, dem weltweit größten Verband technischer Berufe. Seit Juni 2016 arbeitet dieser Verein auch an den P7000-Standards. Darin werden Prozessmodelle entwickelt, um ethische Gesichtspunkte bei der Konzeption und Gestaltung von IT-Systemen zu berücksichtigen. - Toronto Declaration: Veröffentlicht: Mai 2018

Quelle: Toronto Declaration for Human Rights and Artificial Intelligence

URL: https://www.accessnow.org/cms/assets/uploads/2018/08/The-Toronto-Declaration_ENG_08-2018.pdf

Zusammenfassung: Auf der Konferenz RightsCon im Mai 2018 initiierten Amnesty International und AccessNow die Toronto Declaration for Human Rights and Artificial Intelligence. Diese fordert eine stärkere Zusammenarbeit zwischen dem öffentlichen und privaten Sektor, um die Menschenrechte im KI-Zeitalter zu schützen. Sie erinnert beispielsweise an die Wiener Erklärung der VN-Menschenrechtskonferenz oder den Internationalen Pakt über wirtschaftliche, soziale und kulturelle Rechte. Weitere Unterstützer sind Human Rights Watch und die Wikimedia Foundation. - Montreal Declaration: Veröffentlicht: Dezember 2018

Quelle: Montreal Declaration for Responsible Development of Artificial Intelligence

URL: https://www.montrealdeclaration-responsibleai.com/the-declaration

Zusammenfassung: Die Montreal Declaration for Responsible Development of Artificial Intelligence wurde von der Université de Montréal zusammen mit dem Fonds de recherche du Québec entwickelt. Sie wurde im Dezember 2018 der Society for Arts and Technology vorgestellt und ist das Ergebnis von mehr als einem Jahr Beratung mit Philosophen, Soziologen, Juristen und KI-Forschern sowie Online- und Face-to-Face-Umfragen in der Bevölkerung. Die zehn Prinzipien sollen einen ethischen Rahmen für die Entwicklung und Anwendung von KI bilden, als Orientierung bei der digitalen Transformation der Gesellschaft dienen und eine Grundlage für die weitere Diskussion bieten. In Zukunft soll die Deklaration kontinuierlich überarbeitet werden.